Caveman:砍掉 AI 输出 75% 的 Token,一个都不少

- Smars

- Agent skill , AI 效率

- 07 May, 2026

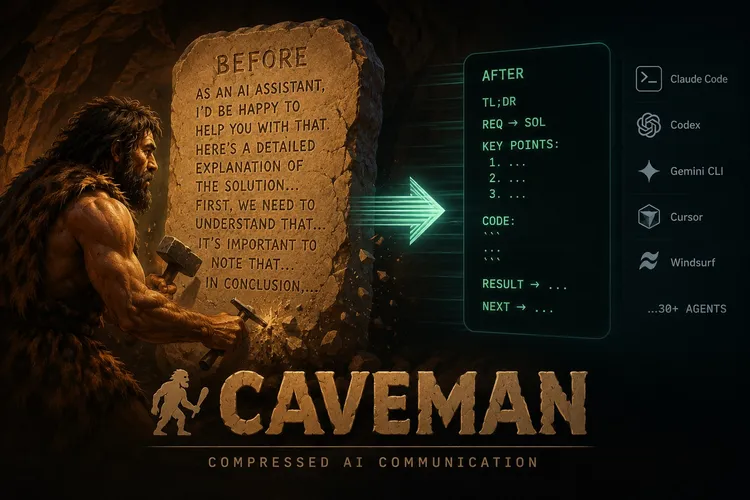

你的 AI Agent 话太多了。每句”当然!我很乐意帮你解决这个问题”都是一个浪费的 token —— 它在烧钱、拖慢响应速度、把真正的答案埋在客套话里。如果你每天都在用 AI 编码 agent —— Claude Code、Cursor、Codex 或任何 LLM 驱动的 agent —— 啰嗦不是性格问题,是每次交互都要付的性能税。AI 默认的沟通风格是为聊天界面设计的,不是为 agent 驱动的编程工作流设计的。

这就是 Caveman 这个 AI Agent skill 解决的问题。它重写 AI 编码助手的沟通方式,砍掉 65-87% 的输出 token,同时保留每一个字节的技术准确性。

少废话,看数据

Caveman 是一个 Claude Code skill(也兼容 Codex、Gemini CLI、Cursor、Windsurf 等 30+ agent),把 AI 的沟通风格重写为电报式压缩语言。它去掉填充词、砍掉礼貌前缀、剥离不必要的语法,同时保留每一个字节的技术信息。

数据不会说谎:

| 指标 | 改善 |

|---|---|

| 输出 Token 减少 | 平均 65%(范围 22–87%) |

| 响应速度 | 快约 3 倍 |

| 技术准确性 | 100% 保留 |

| 可读性 | 显著提升 |

用真实 Claude API 做的基准测试很有说服力。解释 React 重渲染 bug 从 1,180 token 降到 159(省 87%)。调试 PostgreSQL 竞态条件从 1,200 降到 232(省 81%)。实现 React Error Boundary 从 3,454 降到 456(省 87%)。十个不同编程任务下来,平均值从 1,214 token 降到 294。

2026 年 3 月 Arxiv 上的一篇论文(“Brevity Constraints Reverse Performance Hierarchies in Language Models”)发现,对 AI 大模型施加简洁约束后,某些基准测试的准确率反而提升了 26 个百分点。话多不等于对。对于 AI Agent skill 而言,优化输出 token 不只是省钱,还能提升 Agent 的实际表现。

什么时候用

Caveman 最适合高频 AI 编码工作流 —— 你快速迭代,agent 的任务是给你答案,不是陪你聊天。作为一个 AI Agent skill,它的价值随使用量放大。

- Code Review:单行结论取代长篇解释。

L42: 空指针缺保护而不是”我注意到在第 42 行,可能存在一个空指针异常…” - 调试会话:快速诊断-修复循环,每一秒的响应延迟都在累积成本

- 生成提交信息:50 字以内的 Conventional Commit,聚焦原因而非内容

- 长会话:每次交互的输出 token 少了,上下文窗口就能撑更久

对于在共享 agent 上下文(如 Claude Code 的 project mode)中工作的团队来说尤其有价值 —— 多次交互累积的废话会迅速吃掉可用的上下文预算。

这个 skill 不擅长的事

Caveman 不是万能的。

- 向新手解释概念:如果读者需要手把手的引导,远古模式会显得粗鲁或令人费解

- 写面向客户的文档:文档本身应该清晰、结构良好,而不是用电报体

- 需要委婉沟通的任务:比如给初级开发者的 Code Review —— 有时候铺垫本身就是重点

- 本来就很短的回复:如果正常输出已经不到 50 token,压缩空间基本为零

Caveman 只影响输出 token,不影响推理 token(思考链/CoT 追踪),所以模型的内部推理质量不受影响。如果你的瓶颈在 API 费用,caveman 有用。如果瓶颈在模型推理深度,这根杠杆不对。

安装 Caveman

一行命令安装,自动检测 30+ agent:

curl -fsSL https://raw.githubusercontent.com/JuliusBrussee/caveman/main/install.sh | bash常用参数:

| 参数 | 作用 |

|---|---|

| —minimal | 仅安装插件 |

| —all | 完整安装(hooks、状态栏、MCP、规则文件) |

| —only | 只为特定 agent 安装 |

手动安装部分 agent:

# Claude Code

claude plugin marketplace add JuliusBrussee/caveman && claude plugin install caveman@caveman

# Cursor

npx skills add JuliusBrussee/caveman -a cursor使用方法

在任意会话中触发:

/caveman 默认模式

/caveman lite 保留语法,去掉废话

/caveman ultra 极致压缩文言文模式(压缩率更高):

/caveman wenyan 全文言文

/caveman wenyan-lite 半文言,去掉废话

/caveman wenyan-ultra 极致文言压缩退出:“stop caveman” 或 “normal mode”。

配套 Agent 命令:

| 命令 | 用途 |

|---|---|

| /caveman-commit | 生成简洁的 Conventional Commit |

| /caveman-review | 单行 PR Review 评论 |

| /caveman-compress | 压缩 CLAUDE.md 等记忆文件(减 ~46%) |

| /caveman-stats | 查看本次会话 token 节省量 |

实践示例

Caveman 之前的 Claude Code:

“您遇到的问题是数据库连接池的竞态条件。当多个并发请求同时尝试从池中获取连接时,如果释放逻辑不能及时完成,连接池可能会耗尽可用连接。我建议实现一个带有指数退避的重试机制…”

Caveman 版本:

“连接池竞态。并发获取耗尽连接,释放来不及跟上。修法:重试 + 指数退避。”

同样的诊断。同样的修复。省了 75% 的 token。

执行 curl -fsSL https://raw.githubusercontent.com/JuliusBrussee/caveman/main/install.sh | bash ,看看你下一个会话在客套话上烧掉多少 token。你的 API 账单允许你说这句话吗?

客气的 AI 很礼貌。远古的 AI 很好用。选一个。

GitHub: https://github.com/JuliusBrussee/caveman | npm: npx caveman-shrink