OpenClaw 终于长出手和眼:Peekaboo v3

OpenClaw 之前能接消息、能调 Agent、能把结果送到各个聊天渠道,但缺一双手和眼睛。Agent 在聊天框里给建议容易,要它实际操作桌面上的按钮、菜单、弹窗、输入框,之前没有可靠的本地执行层。Peekaboo v3 就是来补这一层的——它在停更多月后正式回归,发布当天就一日三更,v3.1.0、v3.1.1、v3.1.2 接连推出。

把桌面变成 Agent 能理解的工作场域

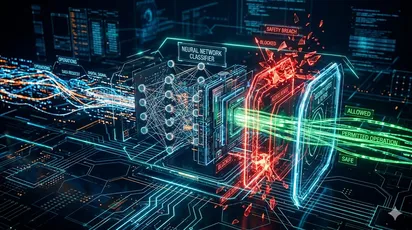

Peekaboo 的核心是一套 macOS 自动化工具:截图、识别窗口、读 UI 元素、找按钮、点按、打字、滚动、切应用、操作菜单。传统脚本最怕环境变化——按钮位置换一下、窗口遮一下、弹窗突然出现,脚本就像踩空楼梯。Agent 更麻烦,因为它要边看边想边操作,任何一步看错都会一路歪下去。Peekaboo 不只是截一张图给模型看,而是把图里的控件、窗口、文本、按钮关系整理成带结构的桌面地图——AI 看到的不是一片像素,而是可追踪、可复盘、可继续操作的现场记录。

从消息系统到操作系统的边缘

OpenClaw 最初解决的是连接问题:人从哪里发消息,消息怎么进来,Agent 怎么处理,结果怎么回去。Peekaboo 解决的是执行问题:Agent 接到任务后,能不能看到真实桌面,能不能找到可操作对象,能不能一步步推进。加上 Peekaboo 之后,OpenClaw 的角色开始变化——它不再只是多渠道消息网关,而有机会成为本机环境里真正能办事的系统。一句话概括,OpenClaw 管「谁来找我」「要做什么」「交给哪个 Agent」,Peekaboo 管「屏幕上有什么」「按钮在哪里」「这一刀该往哪儿落」。

Agent 需要的不是更聪明的建议,而是一双能看清桌面并动手操作的眼睛和手。Peekaboo 补上的正是这个。